Must Read

AI大模型

自注意力机制与多头注意力机制

一、自注意力机制(Self-Attention)

核心思想

自注意力机制通过计算同一序列内元素之间的相关性权重,动态捕捉全局依赖关系。与传统注意力机制(关注外部序列)不同,它聚焦于输入内部的关联性。

计算流程

输入:序列 X=X=(每个xixi为词向量) 输出:加权后的上下文向量 Z=Z=

步骤分解:

线性变换:生成Q(Query)、K(Key)、V(Value)矩阵

Q=XWQ,K=XWK,V=XWVQ=XWQ,K=XWK,V=XWV

(WQ,WK,WVWQ,WK,WV为可学习参数矩阵)

注意力得分计算

Attention(Q,K,V)=softmax(QKTdk)VAttention(Q,K,V)=softmax(dkQKT)V

缩放因子 dkdk:防止点积值过大导致softmax梯度消失

得分矩阵:QKTQKT的每个元素表示词与词之间的关联强度

加权聚合 通过softmax归一化权重后,对Value矩阵加权求和,得到每个位置的上下文向量。

示例解释

以句子 "The animal didn't cross the street because...

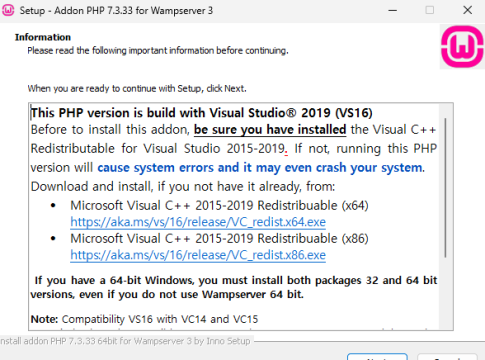

Trending Now

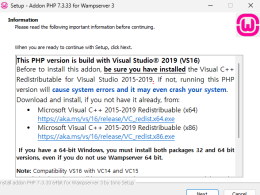

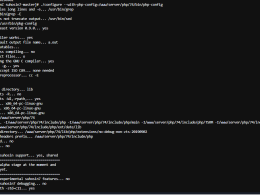

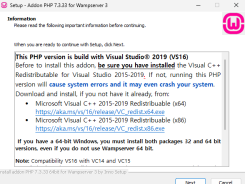

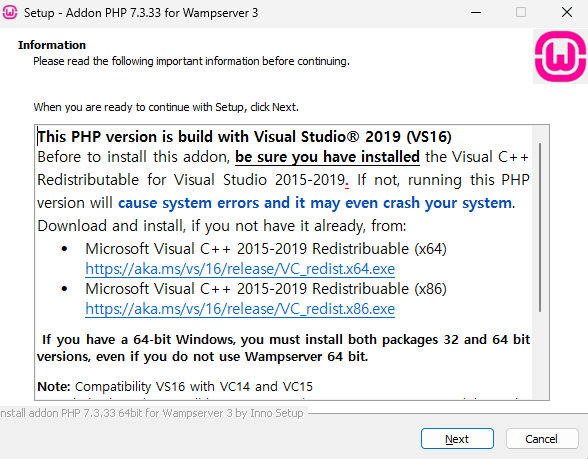

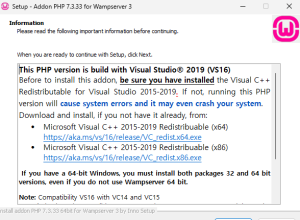

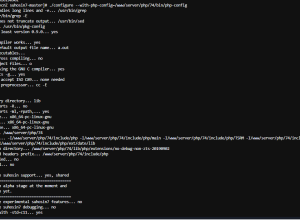

WAMPServer多版本管理:PHP/MySQL/Apache/MariaDB安装与切换指南

如何在wampserver中切换不同的版本以适应本地项目的开发与测试。下面详细记录不同版本的安装与切换。

大模型的概念与发展催势

大模型(Large Model)是指参数规模巨大、计算能力强大的深度学习模型,通常包含数十亿甚至数万亿个参数。这类模型通过海量数据和大量计算资源进行训练,能够处理复杂的任务并展现出强大的泛化能力

什么是ComfyUI?

ComfyUI 是一个基于节点的图形用户界面(GUI),专门为 Stable Diffusion 设计。它通过将图像生成工作流程分解成不同的块(称为节点),用户可以通过链接这些节点来构建复杂的图像生成流程,从而实现精准的工作流定制和完善的可复现性